|

|

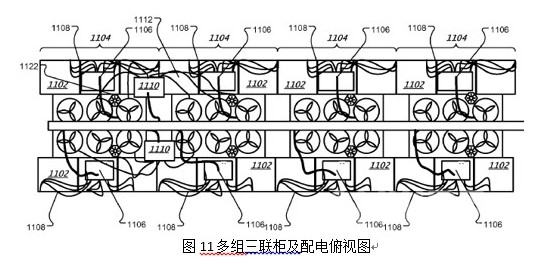

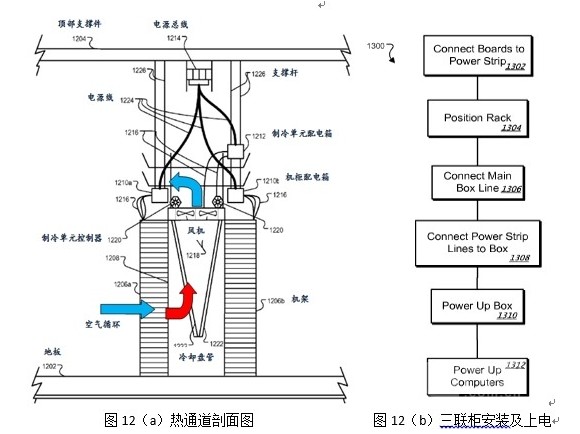

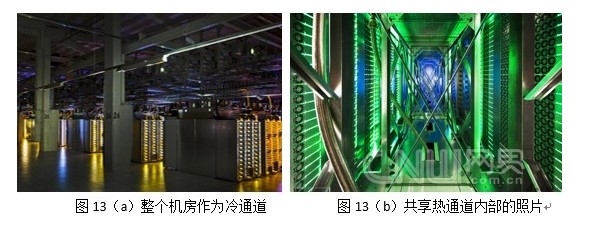

谷歌数据中心供电系统剖析本文简单介绍了谷歌数据中心的供电架构,有些盲人摸象,泛泛介绍了些内容,很多技术细节还有待进一步充实。但从我们了解的有限知识内,这个架构是对传统数据中心供电架构的颠覆,摒除了传统上依靠UPS等硬件冗余的低效率模式,追求能效无极限。同时还在高效建设、便捷运营以及系统可靠性等方面也有很多亮点。虽然这种完全定制的市电直供架构不一定适合国内数据中心用户,但其低成本、简单、高效的模块化建设思路非常值得国内学习。 图11是前面图10中四组三联柜及其配电部分的俯视图,同样的,带9路输出的IT配线盒1106给三联柜1102供电,而带12路输出的空调配线盒 1110则是给热通道顶部置顶空调的3个大风扇供电。不管是1106的IT机柜供电配线盒还是1110的空调风扇供电配线盒都是通过供电线缆从两排机柜中间顶部的供电母排114上取电。 置顶空调1118包含了标识为1120的3 个散热风扇和标识为1122的变频驱动控制器,后者用于控制风扇的转速,同时将置顶空调的故障信息上传到机房监控中。带12路输出的空调配线盒1110中的9路输出用于给三个大风扇供电,而剩余的3路输出则给风扇驱动控制器供电。而置顶空调1118的6个风扇及两个控制器分别从两套12路输出空调配线盒 1110来供电,每边各一个,避免某个配线盒故障导致整个空调停机,来提高空调系统的可靠性。 置顶空调1118的宽度或者相邻空调之间的距离和三联柜1104的宽度可能会不一样,或者说下图的横向方向上置顶空调的数量和三联柜的数量可以一样,也可能不一样,这种配置会随着三联柜功率的不同灵活调整。比如三联柜1104放置高功率服务器情况下,置顶空调和三联柜会一一对应逐个排开,但如果三联柜 1104改上架低功率的服务器后,可能会少安装一些置顶空调1118,这些空缺出来的空调位置可以通过通道顶部的一整块铁皮来封堵。由于整排机柜共享热通道,也共享冷通道,那么置顶空调空缺出来位置的热空气会横向流动或者上下流动,依靠旁边的置顶空调风扇来散热。还有整个机房大环境是冷通道,那么弥散在整个房间内的冷气可以较为均匀地被全部服务器风扇吸入,很少出现局部热点。  图12是数据中心机柜、空调和配电部分的剖面图,整个机房的底部是架空地板1202和顶部的天花1204,整个机房的核心部分由两排机柜1206a和 1206b以及置顶空调1208、9路输出的配线盒1210a和1210b、12路输出的配线盒1212以及母线排1214构成。两排机柜1206a和 1206b从9路输出的配线盒1210a和1210b来取电,两排机柜后面热通道顶部则为置顶空调1208,其包括6个轴流风机1218、一对风扇控制器 1220以及一对散热盘管1222。每组风扇和控制器从带12路输出的配线盒1212上取电。顶部的母线排可能的载流量约为1000A,覆盖多组三联柜机柜和置顶空调单元。  正常工作情况下,1206a-b的服务器散发出来的热量进入共享的热通道内,经过盘管1222制冷后,被热通道顶部的风机1218吹回到整个机房大冷环境内,再重新被服务器风扇吸入,不断循环,机房大冷池环境如图13(a)所示。或者如果刚好部分机柜顶部没有风扇或者该风扇出现故障,则该机柜散发出来的热量会横向流动到相邻带风扇的空调(比如进入或者流出此正视图)被相邻的空调给制冷,共享热通道内部如图13(b)所示,这种冷通道和热通道共享的机制可以大大减少制冷系统的局部故障,提高系统可靠性。  图12(b)是实际部署机柜上电的流程图,首先1302步骤在工厂将每台服务器上架并连好电源线到PDU上,然后是1304步骤将整机柜运送到机房现场泊位,在对应位置固定安装好整机柜并连好机柜接地线,接着是1306步骤在供电母线上安装IT机柜供电配线盒,并在1308步骤上连接每个机柜PDU和顶部配线盒,于1310步骤给配线盒总闸合闸上电,最后在1312步骤给每个机柜的PDU供电开启机柜服务器。我们之前在文章《谷歌的服务器内置UPS技术介绍》中了解到其服务器电源的内部作了上电随机延迟设计,因此不会在整机柜合闸的瞬间导致大电流冲垮熔丝或者支路空开,或者也可以在远程后台逐个上电,避免同时上电的启动冲击。 图14是谷歌数据中心内部的实际照片局部,很多前面介绍的技术细节体现在这个图片中,可以看到顶部母排及配线盒,中间是线缆托架及空调,下面为30U高服务器机柜,每台1.5U高,机柜深度约700mm,冷通道为2块砖1200mm宽。服务器市电直供,机柜顶部的交换机由白色小UPS带,30孔PDU,5个熔丝槽一拖六,供电PDU和铜缆理线器一侧,带专门的理线槽,并采用不同颜色的网线区别相应的功能,总体较为美观整齐。  综上,本文简单介绍了谷歌数据中心的供电架构,有些盲人摸象,泛泛介绍了些内容,很多技术细节还有待进一步充实。但从我们了解的有限知识内,这个架构是对传统数据中心供电架构的颠覆,摒除了传统上依靠UPS等硬件冗余的低效率模式,追求能效无极限。同时还在高效建设、便捷运营以及系统可靠性等方面也有很多亮点。虽然这种完全定制的市电直供架构不一定适合国内数据中心用户,但其低成本、简单、高效的模块化建设思路非常值得国内学习。 责编:王珂玥  微信扫一扫实时了解行业动态 微信扫一扫实时了解行业动态 著作权声明:kaiyun体育官方人口

文章著作权分属kaiyun体育官方人口

、网友和合作伙伴,部分非原创文章作者信息可能有所缺失,如需补充或修改请与我们联系,工作人员会在1个工作日内配合处理。 |

最新专题 推荐圈子 |

|

|